Pas un jour ne passe sans une annonce sur l’intelligence artificielle (IA), qu’il s’agisse d’investissements des mastodontes du Web, de nouveaux services, de dérives réelles ou supposées de cette technologie qui s’impose comme un nouvel eldorado économique et une révolution de société. Au point que certains économistes s’interrogent sur la possibilité d’une bulle de l’IA, similaire à celle de la bulle Internet de la fin des années 1990.

Le récent déploiement d’algorithmes de génération intelligente – comme ChatGPT ou Midjourney – a considérablement modifié le regard du grand public sur l’IA. Pourtant, le concept d’une machine pouvant imiter le cerveau est presque aussi ancien que l’informatique.

Au-delà des fantasmes et des inquiétudes légitimes sur l’IA, de quoi parle-t-on réellement ? Qu’est-ce qui est nouveau dans la révolution actuelle ? Les machines sont-elles devenues plus intelligentes que nous ?

Qu’est-ce que l’IA ?

Il s’agit d’un champ scientifique multidisciplinaire, à la croisée de l’informatique, des mathématiques, de la psychologie cognitive ou encore de la linguistique. Il vise à reproduire certaines compétences humaines, comme le raisonnement, la planification ou la résolution de problèmes, grâce à des algorithmes informatiques.

L’expression « intelligence artificielle » a été introduite en 1956, en référence aux travaux du philosophe positiviste français Hippolyte Taine. En 1870, dans De l’intelligence, celui-ci comparait l’intelligence humaine à une « machine », dont les pionniers de l’IA espéraient modéliser et reproduire le mécanisme.

Mais l’expression a toujours été contestée pour sa polysémie et le fantasme de voir émerger un esprit conscient artificiel. « On ne devrait pas dire intelligence, car cela a été programmé, abonde Karine Deschinkel, enseignante-chercheuse en informatique à l’université de Franche-Comté. C’est un algorithme, presque comme une recette de cuisine, un ensemble de calculs mathématiques qui permet d’apprendre à la machine à exécuter des tâches habituellement dévolues aux humains. »

Certains préfèrent parler d’« informatique avancée », d’« informatique algorithmique », d’« intelligence augmentée » ou d’« intelligence auxiliaire ». Autant de manières, tout en conservant le sigle IA, de mieux circonscrire les attentes.

Pourquoi est-elle en plein essor maintenant ?

Si l’espoir de modéliser l’intelligence humaine de manière informatique naît dans les années 1950, l’optimisme débridé des débuts s’est rapidement heurté à la puissance et à la mémoire restreinte des premiers ordinateurs, ainsi qu’à des divergences philosophiques profondes. « Il y a eu beaucoup de surprises et d’échecs », rappelle Jean-Gabriel Ganascia, informaticien et professeur de philosophie à l’université Paris-Sorbonne.

Signe de ce parcours accidenté, l’économiste américain Herbert Simon (1916-2001) prophétisait que la machine battrait l’humain aux échecs avant 1967. Il a finalement fallu attendre 1997, et la démocratisation de microprocesseurs bien plus puissants, pour qu’un algorithme, Deep Blue, batte le grand maître de renommée mondiale Garry Kasparov. Encore ne s’agissait-il que d’une forme limitée d’intelligence. Deep Blue a procédé par « force brute », un procédé simpliste consistant à évaluer une par une toutes les hypothèses possibles.

Les progrès informatiques, la démocratisation du Web, le développement de nouveaux langages de programmation et les avancées des mathématiques formelles ont néanmoins permis à la discipline de progresser au fil du temps, jusqu’au grand boom des années 2010. Trois facteurs concomitants l’expliquent :

- L’apparition des réseaux neuronaux convolutifs (CNN), un type de neurones artificiels qui excellent à repérer des motifs récurrents dans des fichiers multimédias (images, musiques, etc.), permettant d’en détecter des points communs (par exemple, une forme de trompe pour les éléphants) et les classifier. C’est le développement du machine learning, ou « apprentissage de la machine ».

- Le développement des cartes graphiques, un composant informatique extrêmement efficace pour analyser et classifier les vastes bases de données textuelles et multimédias sur lesquelles l’IA s’« entraîne ». L’essor de l’IA fait d’ailleurs les affaires des fabricants comme Nvidia, désormais valorisé à 2 000 milliards de dollars en Bourse, faisant de son patron et fondateur Jensen Huang le nouveau patron le plus puissant de la tech.

- L’essor du « big data », ou données massives : grâce aux bases de données gigantesques désormais disponibles en ligne en passant par les moteurs de recherche, les banques de données, les objets connectés ou encore et les plates-formes collaboratives, il est possible d’entraîner les algorithmes de classification sur des échantillons à grande échelle. C’est le deep learning, l’apprentissage à partir de vastes quantités d’exemples, souvent annotés par des humains pour « guider » la machine.

Ces trois facteurs ont permis le développement en parallèle de nombreuses solutions d’IA, certaines purement professionnelles, d’autres grand public, qui servent de vitrines à la discipline.

Qu’ont de spécial les IA à la mode ?

ChatGPT, Bard, Midjourney, Stable Diffusion… Les algorithmes qui font les choux gras de la presse et fascinent les internautes depuis 2022 ont un point commun : ce sont tous des IA génératives. Ce sous-type permet de créer du contenu original, souvent pour les industries créatives (cinéma, jeu vidéo, publicité, etc.) qui souhaitent expérimenter des concepts rapidement et à bas coût.

Le Monde

-50% sur toutes nos offres

Accédez à tous nos contenus en illimité à partir de 11,99 € 5,99 €/mois pendant 1 an.

S’abonner

En apparence, leur utilisation a quelque chose de magique, comme une requête formulée au génie de la lampe. « Les gens s’imaginent que la machine invente des choses, mais c’est complètement faux, démystifie Karine Deschinkel. C’est nous qui lui avons donné les algorithmes et les méthodes. »

Son avantage est de pouvoir donner naissance à ce qui n’existe pas mais aurait pu exister. Ainsi de la dixième symphonie de Beethoven, dont on ne connaît que quelques brouillons partiels inachevés. En 2021, sous la supervision d’ingénieurs et de musicologues, un algorithme d’IA nourri aux partitions du compositeur a proposé une version complète de la symphonie, en calculant pour chaque séquence quel enchaînement de notes était le plus probable, à défaut d’être le plus poétique, au regard de l’œuvre déjà existante de l’artiste.

L’offre en la matière a explosé depuis la fin 2022. Il ne s’agit pas en soi d’une révolution technologique, car ce type d’IA existe depuis une dizaine d’années dans les laboratoires des géants de la tech, mais ces derniers ont préféré ne pas rendre publiques leurs recherches, le temps de perfectionner ces outils. Ce n’est pas le cas de start-up comme OpenAI. Grâce à elle s’est opérée une révolution d’usage : depuis que ces IA sont en accès public, n’importe quel internaute peut générer grâce à un logiciel des poèmes, des chansons de rap, des affiches de film, etc., sorties d’une imagination algorithmique. Mais il ne s’agit que d’un type d’IA.

Quelles sont les différentes applications de l’IA ?

Elles sont de plus en plus vastes.

Sur Internet, de nombreux moteurs de recherche comme Google ou Bing apportent des réponses personnalisées en fonction des requêtes des utilisateurs, de la même manière que la messagerie en ligne Gmail propose de manière prédictive des formules de politesse dans les courriels. L’IA est également derrière les publicités ciblées, la traduction automatisée ou encore les agents de conversation, ou chatbots.

Dans la vie de tous les jours, grâce à sa puissance de calcul, l’IA est désormais utilisée pour les prévisions météorologiques, l’animation des centres d’appels téléphoniques, l’analyse de profils pour le recrutement, mais aussi la prédiction du trafic routier, l’analyse d’images médicales, la gestion des inventaires, ou encore la rédaction automatisée de courts articles journalistiques. L’industrie pharmaceutique compte également dessus pour créer de nouveaux médicaments.

Dans le monde médical, des IA spécialisées dans l’analyse et l’interprétation des radios aident désormais les urgentistes à détecter certaines fractures qui seraient passées inaperçues, soit du fait de la fatigue du praticien, soit parce qu’elle est trop fine. « C’est une sorte de clignotant, de warning, observe Laure Abensur Vuillaume, spécialiste en médecine d’urgence au CHR Metz-Thionville. L’IA ne fait pas mieux que le médecin mais le couple IA-médecin fait mieux que le médecin seul. »

L’IA peut également être « embarquée » : voitures autonomes, thermostats intelligents, objets connectés, robots industriels, etc.

L’IA est-elle vraiment intelligente ?

C’est le grand fantasme que charrie son nom, mais à ce jour, pas vraiment. L’IA est capable d’imiter plusieurs aspects fonctionnels de l’intelligence humaine (perception de l’environnement, mémorisation, langage, motricité, calcul, résolution de problèmes…), mais de manière essentiellement monotâche. Elle n’a pas la capacité de ressentir, d’éprouver des émotions, de manifester de la curiosité, de sortir du champ pour lequel elle a été conçue, ni d’avoir une forme de conscience d’elle-même.

On peut distinguer trois grands niveaux théoriques d’IA :

- La superintelligence, qui dépasserait les capacités cognitives humaines, et mènerait à la singularité technologique, c’est-à-dire à un bouleversement imprévisible du cours des événements. Comme le personnage de Skynet dans Terminator ou la matrice dans Matrix, elle relève de la science-fiction.

- L’IA forte, qui offrirait une polyvalence, une sophistication et un niveau de conscience comparables à l’humain, et serait capable de résoudre des problèmes dans des environnements complexes. C’est celle qu’avaient en vue les pionniers du domaine. Perçue comme une vue philosophique, elle est à ce jour hors de portée, faute de supercalculateurs assez puissants et de compréhension et modélisation fine de l’intelligence humaine.

- L’IA faible ou l’IA étroite, celle des ingénieurs, qui imite de manière restreinte et ultraspécialisée certains aspects de la pensée humaine. Il s’agit aujourd’hui de la quasi-totalité des IA en circulation. Fonctionnelles, elles sont capables d’analyser leur contexte d’intervention, de résoudre des problèmes, d’entreprendre des actions dans le but qui leur a été fixé, et de s’adapter dans une certaine mesure à la situation, mais pas de sortir de leur cadre.

Même les IA faibles ne sont pas à proprement parler « intelligentes ». Elles infèrent des gigantesques bases de données sur lesquelles elles sont « entraînées » pour apporter la réponse à leurs yeux la plus probable à la requête de l’utilisateur. Comme l’expliquait en 2019 l’ingénieur franco-américain Luc Julia, concepteur de l’assistant vocal d’Apple, Siri, à propos de l’algorithme de jeu de go AlphaGo : « Il n’y a pas d’intelligence, simplement une masse de données et un peu de statistiques. »

Les IA sont-elles infaillibles ?

Certainement pas. Les IA actuelles ont plusieurs défauts majeurs.

Les hallucinations. Il est fréquent que des IA, notamment génératives, assènent sur un ton péremptoire des affirmations entièrement inventées. En 2023, un cabinet d’avocats s’est ainsi fait rabrouer par un juge new-yorkais pour avoir rendu un mémoire rédigé par ChatGPT dans lequel l’algorithme avait glissé, sur un ton affirmatif particulièrement convaincant, six arrêts de justice en réalité complètement fictifs.

Google a estimé que la réduction de ces hallucinations était actuellement le défi « fondamental » des IA génératives. Le quotidien régional L’Est républicain tire ainsi des leçons partagées de l’usage expérimental de ChatGPT pour titrer et éditer les articles : si la direction s’est félicitée d’un gain de temps, les journalistes ont constaté de nombreuses approximations et erreurs contraires à l’éthique d’un journal d’information.

Les biais. Les IA étant « entraînées » sur des bases de données, il suffit que celles-ci comportent des biais pour que l’algorithme les reproduise. En 2016, Microsoft avait ainsi dû rapidement mettre hors ligne Tay, une IA conversationnelle, qui avait tenu des propos négationnistes. « Beaucoup de gens nous disent que cela montre que l’IA a des préjugés, expliquait à l’époque la chercheuse britannique Joanna Bryson dans le Guardian. Mais non. Cela montre que nous avons des préjugés, et que l’IA les apprend. » L’usage de l’IA dans la vidéosurveillance témoigne ainsi de biais ethniques. L’ingénieure en informatique Joy Buolamwini, fondatrice de l’Algorithmic Justice League – une organisation visant à combattre les préjugés dans les processus de décision des logiciels –, a montré dès 2018 que son taux d’erreur d’identification était de 1 % pour un homme blanc mais de 35 % à 38 % pour une femme de couleur.

Les failles. Enfin, les IA peuvent être détournées de leur usage initial par des utilisateurs mal intentionnés, soit en jouant avec les instructions, soit en « empoisonnant » leur base de données. C’est ainsi qu’une faille, dite de la « grand-mère », a permis à des internautes de faire énoncer par ChatGPT la recette d’une bombe.

L’IA présente-t-elle des risques ?

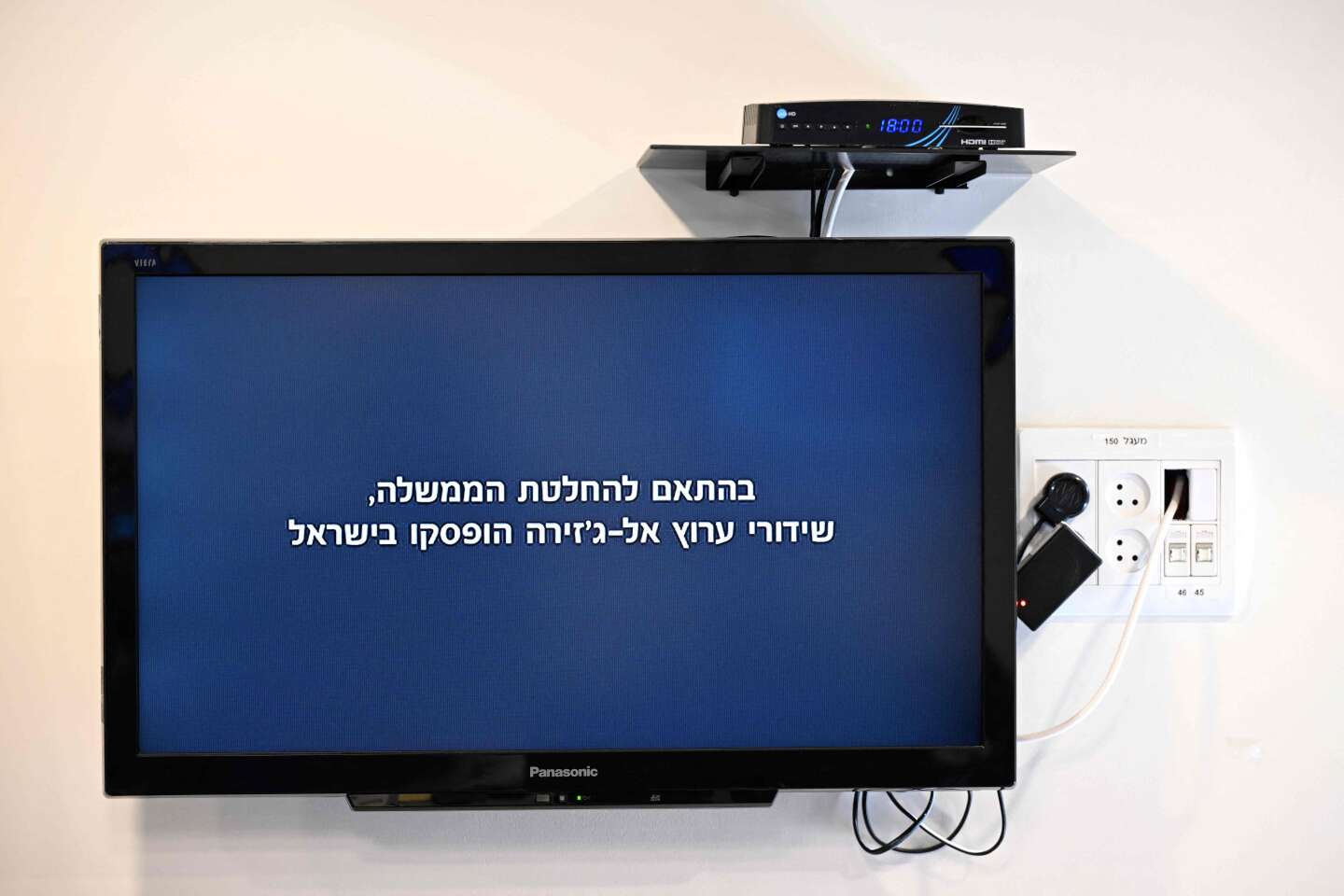

Assurément. Ils sont liés à la fois à la sensibilité des domaines dans lesquels elle est utilisée et à une défaillance, ou une malveillance, dans le contrôle humain. Dévoyée, l’IA peut en effet servir à rédiger des spams alléchants, faire de l’hameçonnage de données personnelles, réaliser des sites Web trompeurs, générer des images violentes, racistes ou sexistes (par exemple pour générer de fausses photos pornographiques de célébrités ; pour rhabiller sur des photos des femmes à la tenue jugée trop légère). Elle peut également avoir un usage antidémocratique. En Russie, des IA sont entraînées à identifier les participants à des manifestations anti-Poutine.

Ses dysfonctionnements et biais statistiques peuvent également avoir des répercussions graves, d’autant que les algorithmes d’IA sont utilisés dans le monde de la justice, de la santé, et même du militaire − l’armée américaine a expérimenté avec succès un avion de combat piloté par IA. Une enquête du site indépendant israélien +972 révèle que l’armée de l’Etat hébreu s’appuie de manière excessivement confiante sur une IA, Lavender, pour définir les cibles de ses bombardements, malgré des erreurs d’identification constatées dans 10 % des cas.

« Il faut être très attentif à ne pas utiliser des techniques d’IA de manière inconsidérée et à ne pas leur faire une confiance excessive », alerte Jean-Gabriel Ganascia. En mars 2024, dans une résolution, l’Organisation des Nations unies a appelé à établir des règles internationales claires encadrant les usages de l’IA.