Character.AI va bloquer l’accès à ses robots conversationnels aux moins de 18 ans à compter du 25 novembre, a annoncé l’entreprise dans un message posté sur son site, mercredi 29 octobre. Le service américain, qui revendique 20 millions d’utilisateurs mensuels, permet de discuter avec des milliers de personnages imaginés par ses utilisateurs et animés par son intelligence artificielle (IA). Des personnages qui vont des héros de jeux vidéo aux grandes figures historiques, en passant par les vampires ou des IA aux noms éloquents, comme agressive boyfriend (« petit ami agressif »).

Character.AI précise que la vérification de la majorité a été confiée à plusieurs prestataires, et notamment à Persona, qui vante la capacité à de son outil de détection à estimer l’âge sur la base d’un simple selfie.

Pression des régulateurs

L’âge minimal requis pour utiliser Chatacter.AI était jusqu’à présent de 13 ans. Pour expliquer le passage à 18 ans, l’entreprise mentionne les articles de presse s’inquiétant de la sécurité des adolescents confrontés aux IA ainsi que la pression des régulateurs.

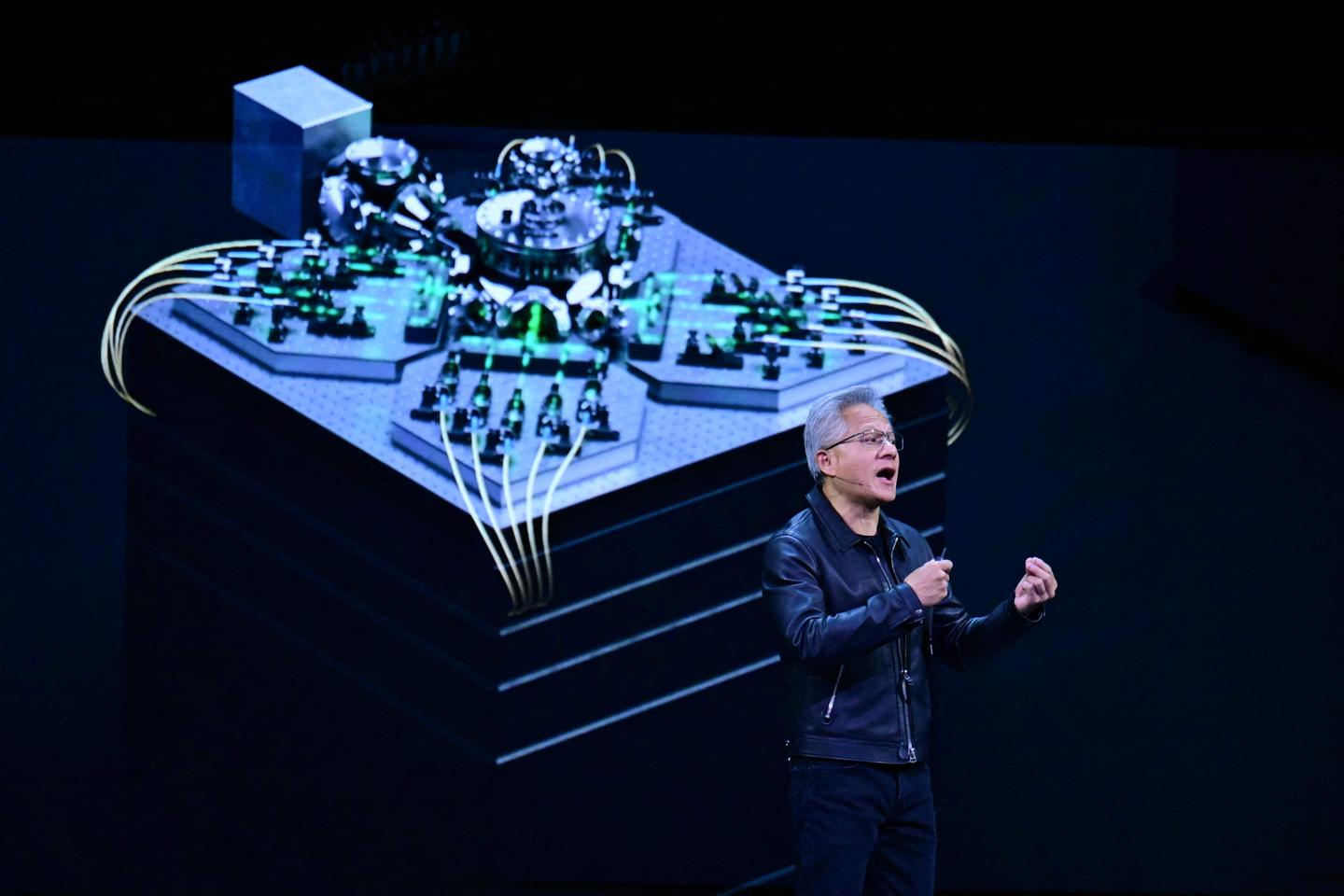

Le gendarme de la concurrence et de la protection de consommateurs aux Etats-Unis, la Federal Trade Commission (FTC), a ainsi ouvert une enquête sur les dommages que pourrait causer aux enfants l’usage des robots conversationnels, comme ceux de Character.AI mais aussi OpenAI (ChatGPT), Meta ou Snap Inc.

L’Etat de Californie, de son côté, a récemment voté une loi encadrant l’usage des robots conversationnels, leur interdisant notamment d’encourager les propos suicidaires. Plus récemment encore, mardi, deux sénateurs ont fait part de leur intention de déposer une loi bipartisane qui interdirait l’accès des tous les chatbots aux mineurs américains, rapporte NBC News.

Ces initiatives font suite à une série de suicides et d’épisodes psychotiques dans lesquels diverses IA ont joué un rôle-clé – et qui n’ont pas touché que des adolescents.

En 2024, selon le quotidien anglais The Guardian, une famille a porté plainte contre Character.AI à la suite du suicide d’un adolescent de 14 ans, qui avait développé un attachement émotionnel à l’un de ses personnages. Depuis le mois d’août 2025, OpenAI fait également l’objet d’une procédure en justice, cette fois aux Etats-Unis, son IA conversationnelle ChatGPT étant accusé d’avoir encouragé leur fils à mettre fin à ses jours.